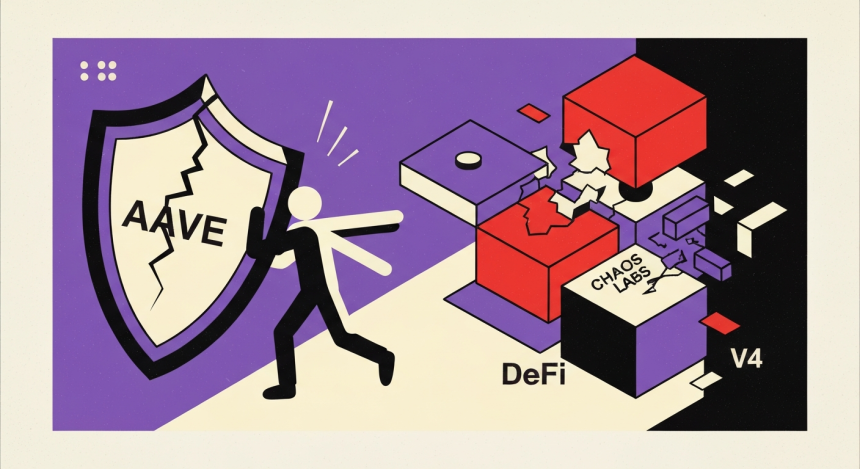

중국 인공지능 개발사 딥시크(DeepSeek)가 새로운 오픈소스 대형언어모델(LLM) 시리즈 ‘V4’를 공개했다. 이번 시리즈는 고성능 모델 ‘V4-Pro’와 경량형 모델 ‘V4-Flash’로 구성됐으며, 메모리 사용량을 크게 줄이면서도 성능 경쟁력을 끌어올린 것이 핵심이다.

V4는 26일 공개됐으며, 두 모델 모두 ‘전문가 혼합’ 구조로 설계됐다. 이는 하나의 거대한 신경망이 아니라 여러 개의 신경망이 역할을 나눠 처리하는 방식이다. 최상위 모델인 V4-Pro는 총 1조6000억 개의 파라미터를 갖췄고, 실제 답변 생성 시에는 이 가운데 490억 개만 활성화한다. 반면 V4-Flash는 2840억 개의 파라미터를 탑재하고, 추론 과정에서는 130억 개를 사용한다. 성능과 비용의 균형을 달리한 구조다.

하이브리드 어텐션과 메모리 효율 개선

이번 V4 시리즈의 가장 눈에 띄는 변화는 ‘하이브리드 어텐션’ 메커니즘이다. 어텐션은 사용자가 입력한 문장 가운데 어떤 정보가 중요한지를 가려내는 기술이다. 딥시크는 이 과정에서 활용되는 ‘KV 캐시’를 두 가지 압축 방식으로 줄여, 이전 세대 모델보다 추론 시 메모리 사용량을 90% 낮췄다고 밝혔다. 이는 같은 하드웨어로 더 긴 문맥을 처리하거나 운영 비용을 줄이는 데 유리한 요소다.

학습 구조와 최적화 방식

학습 효율을 높이기 위한 설계도 함께 적용됐다. V4에는 ‘mHC’라는 기능이 들어가 일부 데이터가 중간 층을 모두 거치지 않고 먼 층으로 직접 이동할 수 있도록 했다. 이 방식은 학습 과정의 오류를 줄여 출력 품질 개선에 도움을 준다. 또 ‘Muon’이라는 소프트웨어 모듈을 활용해 숨은 층 최적화도 진행했다. 딥시크는 이를 통해 학습 속도를 높이고 인프라 부담도 줄였다고 설명했다.

학습 규모도 상당하다. 딥시크는 약 27조 개 토큰 규모의 데이터셋으로 V4의 초기 학습을 진행한 뒤, 두 단계의 후속 학습 절차를 거쳤다. 첫 단계에서는 각 모델을 구성하는 개별 신경망을 따로 최적화했고, 두 번째 단계에서는 이들 신경망이 더 유기적으로 협업하도록 조정했다.

성능 평가와 공개 의미

성능 면에서는 주력 모델 V4-Pro가 약 24개의 벤치마크에서 평가됐다. 딥시크는 이 결과를 클로드 오퍼스 4.6 등 주요 첨단 모델과 비교했으며, V4-Pro가 최소 3개 벤치마크에서 경쟁 모델들을 앞섰다고 밝혔다. 일부 테스트에서는 특정 경쟁 모델보다 높은 점수를 기록했지만, 모든 모델을 일관되게 압도한 것은 아니었다.

이번 공개는 오픈소스 LLM 경쟁이 다시 한층 치열해지고 있음을 보여준다. 고성능 모델 개발이 폐쇄형 중심으로 흘러가는 가운데, 딥시크는 ‘효율’과 ‘개방성’을 동시에 내세우며 존재감을 키우는 모습이다. V4-Pro와 V4-Flash는 현재 허깅페이스(Hugging Face)에서 프리뷰 형태로 제공되고 있다.

TP AI 유의사항 TokenPost.ai 기반 언어 모델을 사용하여 기사를 요약했습니다. 본문의 주요 내용이 제외되거나 사실과 다를 수 있습니다.

0

0

![[토큰분석] 미국 세금 환급액 2,417억 달러… 비트코인 리테일 수요 '깜짝 촉매' 되나](https://f1.tokenpost.kr/2026/04/f2xcrxls4p_th_860x0.jpg)

![[토큰분석] 싱가포르 MAS, 비허가형 블록체인 암호화폐 건전성 규제 완화 추진](https://f1.tokenpost.kr/2025/05/ia54bt2ir1_th_860x0.jpg)

![[토큰분석] 비트코인, 아무도 모르는 사이 추세가 바뀌었다](https://f1.tokenpost.kr/2026/04/i7t9ms0ep3_th_860x0.webp)

![[Episode 12] IXO™2024 참여하고, 2억원 상당 에어드랍 받자!](https://f1.tokenpost.kr/2024/03/bk2tc5rpf6_th_860x0.png)

![[Episode 11] 코인이지(CoinEasy) 에어드랍](https://f1.tokenpost.kr/2024/02/g0nu4cmps6_th_860x0.png)

![[Episode 8] Alaya 커뮤니티 입장하고, $AGT 받자!](https://f1.tokenpost.kr/2023/10/0evqvn0brd_th_860x0.png)

![[Episode 6] 아트테크 하고, 에어드랍 받자!](https://f1.tokenpost.kr/2023/08/3b7hm5n6wf_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 581회차](https://f1.tokenpost.kr/2026/04/9epgx2rg9j_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 580회차](https://f1.tokenpost.kr/2026/04/1d4yk2lv4f_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 579회차](https://f1.tokenpost.kr/2026/04/opj4bfefd6_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 578회차](https://f1.tokenpost.kr/2026/04/b3a6n1ts6b_th_860x0.webp)