미국 연방 상원에서 인공지능(AI) 개발자의 법적 책임을 완화하는 입법안이 발의됐다. 이 법안은 의료, 법률, 공학 등 고도로 전문화된 분야에서 AI를 사용하는 전문가들이 신뢰 가능한 기술을 적절히 판단할 수 있도록 정보를 제공하면서도, 개발자들이 불필요한 법적 리스크에 시달리지 않도록 보호하는 데 초점을 맞췄다.

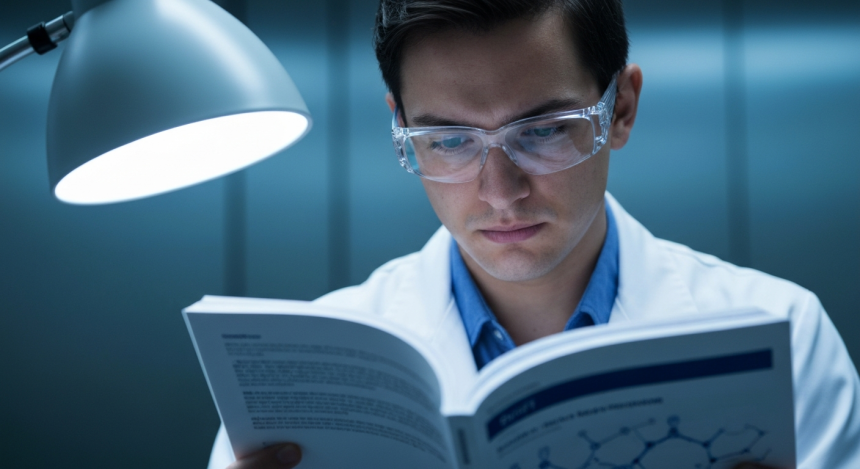

'책임 있는 혁신 및 안전한 전문성법(RISE Act of 2025)'은 미 와이오밍주 공화당 상원의원 신시아 루미스(Cynthia Lummis) 주도로 발의됐다. 루미스 의원은 이 법안을 “전문가급 AI에 대한 미국 최초의 책임 완화 법안”이라며, 미래 혁신의 기반을 조성하기 위한 장치라고 설명했다. 법안은 특히 의료인, 변호사, 금융 전문가 등이 AI를 고객에게 적용할 때 개발자의 책임을 줄이되, 해당 AI의 구성 및 성능 사양(model cards 등) 공개는 의무화하는 방식이다.

하지만 이 법안을 두고 논란도 이어지고 있다. 시러큐스대학교 공공정책대학원의 하미드 에크비아(Hamid Ekbia) 교수는 “투명성 명목으로 기술 사양만 공개하면 개발자는 사실상 광범위한 면책 특권을 갖게 된다”며 “실질적인 위험은 의료진, 법조인 등 현장 전문가들에게 전가된다”고 비판했다. 일부 진보 성향 커뮤니티에서는 이번 법안이 AI 기업들에게 규제 회피용 ‘면허’를 발급해주는 것 아니냐는 비판도 제기됐다.

반면 법률 전문가 펠릭스 시프케비치(Felix Shipkevich)는 “예측 불가능한 대규모 언어모델의 출력 결과에 대해, 개발자에게 무한한 법적 책임을 부과하는 것은 오히려 비합리적”이라며, 어떤 보호 장치도 없는 상황이 더 큰 위험을 초래할 수 있다고 평가했다. 그는 “명백한 과실이나 악의가 없다면 책임을 일정 부분 면제해주는 건 타당한 법적 접근”이라고 덧붙였다.

이번 법안이 다루는 범위는 엄격히 제한돼 있다. 예컨대 재무설계사나 영상의학과 의사처럼 전문직 종사자가 AI를 보조 도구로 사용할 경우에 국한된다. 반면, 청소년이 AI 챗봇을 디지털 친구로 활용하다 자살에 이른 플로리다 사건처럼 일반 이용자와 AI 간 직접적 상호작용에서 발생하는 책임 문제는 논외로 취급되고 있다.

유럽연합(EU)의 접근 방식과도 대조적이다. EU는 2023년 ‘AI 법안’을 통해 권리 기반 규제 모델을 채택하며, 사용자나 소비자, 환자 등 일반 시민의 권리를 우선시한다. 개발자들에게 기술 문서와 사양만 명시하라고 요구하는 미국식 ‘리스크 기반’ 접근은 EU에 비해 사용자 보호 수준이 낮다는 평가가 나온다. AI 연구단체 ‘AI 퓨처 프로젝트’의 다니엘 코코타얄로(Daniel Kokotajlo) 이사도 “현재 법안은 투명성 의무를 최소한으로 규정했다”며, 기업이 공개 대신 책임을 떠안을 선택지까지 둔 점을 비판했다.

관련 업계와 학계에서도 현실적인 기준과 통합적 규정 필요성을 제기한다. 서리대학교 법대의 교수이자 의사인 라이언 애봇(Ryan Abbott)은 “AI가 건강관리 분야에서 야기할 수 있는 책임 문제는 특히 복잡하다”며, 인간 전문가보다 AI 사용이 오히려 더 나은 결과를 낳는 경우도 있어 명확한 기준 설정이 필요하다고 강조했다.

법안 통과 여부는 아직 불투명하지만, 업계는 첫 발걸음으로 평가한다. ‘책임 있는 혁신을 위한 미국인들(ARI)’의 정책 부사장 저스틴 불럭(Justin Bullock)은 “RISE 법안은 투명성 가이드라인, 제한된 범위 내 안전망, 전문가 중심 책임 규칙 같은 강점이 있다”며 긍정적으로 봤다. 다만 “외부 감사와 위험 평가 없이 단순히 기술 사양만 공개하는 것은 허위 안심 효과를 낳을 수 있다”는 점도 함께 지적했다.

트럼프 대통령이 소비자 보호 기구에 대한 통제를 강화하는 가운데, 이번 법안이 기술 기업에 더 유리한 방향으로 제도 설계가 이뤄지고 있다는 우려도 나온다. 법안이 최종 의회를 통과할 경우 2025년 12월 1일부터 시행될 예정이다. AI 기술이 사람의 생명과 자유에 깊숙이 관여하는 시대, 보다 정교하고 균형 잡힌 규제 프레임워크 필요성이 절실히 제기되고 있다.

0

0

![[오후 뉴스브리핑] 미국 디지털자산 규제 체계 확립을 위한 클래리티 법안이 상원 전체 표결 단계로 넘어갔다 外](https://f1.tokenpost.kr/2026/05/e9jroozxps_th_860x0.webp)

![[마켓분석] 트럼프 방중 기대감에 빅테크·비트코인·원유 동반 강세…금·보잉은 약세](https://f1.tokenpost.kr/2026/05/v6fwcsfqtx_th_860x0.jpg)

![[경제분석] 호르무즈 봉쇄 장기화… 시장이 보내는 '인플레 재점화' 경고](https://f1.tokenpost.kr/2026/05/0qy2phqkps_th_860x0.jpg)

![[에너지분석] 호르무즈 패싱 가속화… UAE, 우회 수출 인프라 2배 확장](https://f1.tokenpost.kr/2026/05/esfcf8n5ol_th_860x0.png)

![[Episode 12] IXO™2024 참여하고, 2억원 상당 에어드랍 받자!](https://f1.tokenpost.kr/2024/03/bk2tc5rpf6_th_860x0.png)

![[Episode 11] 코인이지(CoinEasy) 에어드랍](https://f1.tokenpost.kr/2024/02/g0nu4cmps6_th_860x0.png)

![[Episode 8] Alaya 커뮤니티 입장하고, $AGT 받자!](https://f1.tokenpost.kr/2023/10/0evqvn0brd_th_860x0.png)

![[Episode 6] 아트테크 하고, 에어드랍 받자!](https://f1.tokenpost.kr/2023/08/3b7hm5n6wf_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 596회차](https://f1.tokenpost.kr/2026/05/tjh3hukuaj_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 594회차](https://f1.tokenpost.kr/2026/05/klp8a8aqqa_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 593회차](https://f1.tokenpost.kr/2026/05/gunh9vv3g2_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 592회차](https://f1.tokenpost.kr/2026/05/nro9vnqod6_th_860x0.webp)

![[오후 뉴스브리핑] 美 하원, 스테이블코인 규제법·시장구조법 동시 처리 검토 外](https://f1.tokenpost.kr/2025/06/o3tqe1a5qb_th_860x0.jpg)