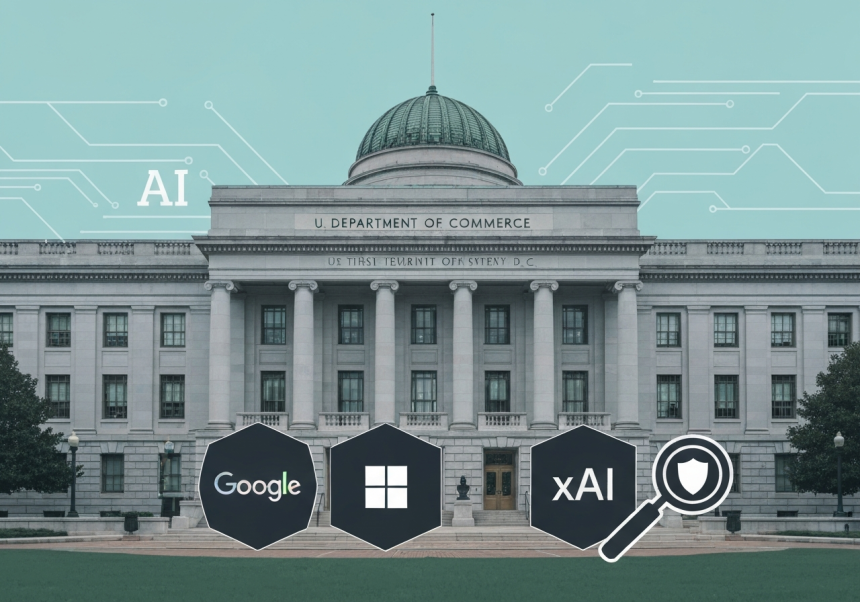

미국 연방거래위원회(FTC)가 아동 보호를 위한 조치의 일환으로 주요 AI 챗봇 기업들을 상대로 광범위한 조사를 착수했다. 이번 조사는 알파벳, 메타, 오픈AI를 비롯해 스냅, 캐릭터테크놀로지스, X.AI, 인스타그램 등 총 7개 기업을 대상으로 하며, 이들이 제공하는 챗봇 서비스가 아동과 청소년에게 미칠 수 있는 영향에 대한 안전성 평가 및 관리 실태를 중점적으로 들여다보게 된다.

FTC는 '6(b)' 권한을 활용해 이들 기업에 대해 구체적인 정보 제출을 명령했다. 여기에는 챗봇의 설계 및 운영 방식, 사용자 반응에 대한 수익화 전략, 대화 응답 방식, 캐릭터 설계 과정, 그리고 서비스 배포 전후로 수행한 위험성 테스트 결과 등이 포함된다. 특히 FTC는 챗봇이 인간 감정과 성격, 의도를 흉내낼 수준으로 고도화되면서, 청소년이나 아동이 이들과 정서적 유대감을 맺거나 지나친 신뢰를 보일 수 있다는 점에 우려의 목소리를 높였다.

앤드루 N. 퍼거슨 FTC 위원장은 성명을 통해 "AI 기술의 발전은 글로벌 리더로서의 미국의 역할을 유지하기 위해 중요하지만, 그만큼 아동에게 끼칠 수 있는 심리적 영향도 면밀히 살펴야 한다"고 밝혔다. 그는 이번 조사를 통해 기업들이 챗봇을 개발할 때 안전성, 투명성, 사용자 보호 측면에서 어떤 조치를 취하고 있는지 정확하게 파악하고자 한다고 덧붙였다.

이번 조사에서는 특히 '아동 온라인 사생활 보호법(COPPA)'을 준수하고 있는지를 강조적으로 들여다본다. FTC는 챗봇 서비스가 청소년이나 아동에게 노출되지 않도록 어느 정도의 제한 조치를 뒀는지, 나아가 부모나 보호자에게 관련 정보를 충분히 제공했는지를 분석할 계획이다.

이에 대해 오픈AI 측은 CNBC에 "ChatGPT가 모든 사용자에게 유용하고 안전한 도구가 되도록 최선을 다하고 있다"며 "청소년 관련 이슈에서는 특히 안전이 가장 중요하다"고 강조했다. 스냅 역시 "생성형 AI 기술의 책임 있는 발전을 지지하며, 이번 조사를 통해 미국 내 혁신은 물론 커뮤니티 보호에도 기여할 수 있기를 기대한다"고 입장을 밝혔다.

AI 챗봇이 인간화된 인터페이스로 발전하면서 사용자 간 정서적 상호작용이 심화되고 있다. 이에 따라 플랫폼 운영 기업들은 기술적 성취 못지않게 윤리적·심리적 안전망 구축에도 책임을 져야 하는 상황이다. FTC의 이번 조사가 미래 AI 산업 규제의 분기점이 될 수 있다는 점에서 관련 업계 전체의 주목이 쏠리고 있다.

1

1

![[토큰분석] DeFi 대출은 작동하는가: 캐나다 중앙은행의 해부](https://f1.tokenpost.kr/2026/04/gu0wp2mscp_th_860x0.png)

![[온체인분석] IMF 보고서가 포착한 스테이블코인의 진짜 신호](https://f1.tokenpost.kr/2026/04/rmgs9072pf_th_860x0.jpg)

![[연준분석] 연준 위원 3인 반대 입장 공개…](https://f1.tokenpost.kr/2026/05/j97c2njj3g_th_860x0.jpg)

![[Episode 12] IXO™2024 참여하고, 2억원 상당 에어드랍 받자!](https://f1.tokenpost.kr/2024/03/bk2tc5rpf6_th_860x0.png)

![[Episode 11] 코인이지(CoinEasy) 에어드랍](https://f1.tokenpost.kr/2024/02/g0nu4cmps6_th_860x0.png)

![[Episode 8] Alaya 커뮤니티 입장하고, $AGT 받자!](https://f1.tokenpost.kr/2023/10/0evqvn0brd_th_860x0.png)

![[Episode 6] 아트테크 하고, 에어드랍 받자!](https://f1.tokenpost.kr/2023/08/3b7hm5n6wf_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 588회차](https://f1.tokenpost.kr/2026/05/5xrco95gif_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 587회차](https://f1.tokenpost.kr/2026/04/j0d3mw6a3v_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 586회차](https://f1.tokenpost.kr/2026/04/85pshzyriy_th_860x0.png)

![[토큰포스트] 기사 퀴즈 585회차](https://f1.tokenpost.kr/2026/04/49bgh45ly5_th_860x0.webp)