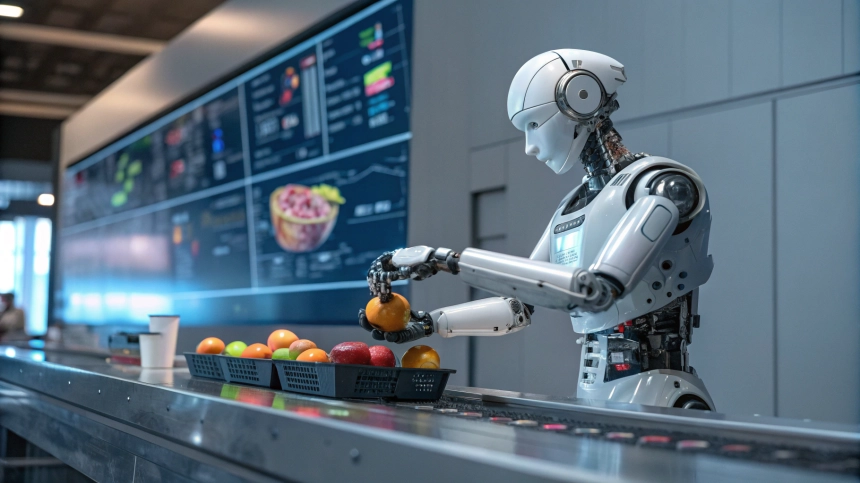

구글(GOOGL)의 인공지능 연구 조직인 딥마인드(DeepMind)가 자사의 로봇용 AI 모델 ‘제미니 로보틱스 1.5(Gemini Robotics 1.5)’와 이의 추론형 확장 모델 ‘제미니 로보틱스-ER 1.5(Gemini Robotics-ER 1.5)’에 대한 대규모 업그레이드를 단행했다. 이번 개선을 통해 로봇은 단순 반복 작업을 넘어서, 여러 단계를 요구하는 복합적인 물리적 과제를 수행하는 ‘지능형 에이전트’로 거듭나게 됐다.

딥마인드에 따르면 새롭게 업그레이드된 모델은 세탁물의 색상 분류, 날씨에 따른 짐 꾸리기, 폐기물 분리 등 실제 생활에서 직면하는 일들을 로봇이 스스로 판단하고 수행하도록 돕는다. 특히 '날씨에 따라 옷을 고르는' 작업에서 로봇은 웹 검색을 통해 뉴욕이나 런던의 실제 기상 정보를 수집하고, 이를 기반으로 사용자에게 적절한 복장을 제안해 짐을 싼다. 이러한 기능은 단순히 정보를 검색하는 수준에 그치지 않고, 추론을 거쳐 실행 가능한 물리적 행동으로 전환된다는 점에서 의의가 크다.

딥마인드는 두 모델 간의 상보적 작동 구조를 통해 이러한 고난도 임무를 가능케 한다고 설명했다. 제미니 로보틱스-ER 1.5는 상황을 분석하고 복잡한 작업 계획을 세운 뒤, 해당 계획을 제미니 로보틱스 1.5가 그대로 실행하는 방식이다. 첫 번째 모델은 ‘비전-언어-행동(VLA)’ 프레임워크에 기반해 이미지를 인식하고, 언어 기반 명령을 물리적 동작으로 변환한다. 반면 추론형 모델인 ER 1.5는 웹 브라우저 등 디지털 도구를 적극 활용해 상황 인식을 확장하며, 이를 통해 사전 단계에서 다층적인 사고를 수행한다.

딥마인드 로보틱스 책임자 카롤리나 파라다(Carolina Parada)는 “이번 버전에서 우리는 단일 명령 처리 수준을 넘어서, 물리적 상황에 대한 포괄적 이해와 문제 해결 역량이라는 새로운 차원으로 도약했다”고 강조했다. 특히 모델 간 지식 이전이 가능하다는 점도 주목할 부분이다. 특정 로봇 플랫폼(예: ALOHA2)에서 학습한 작업을 다른 형태의 로봇 플랫폼(예: 프랑카, 아폴로)에서도 거의 동일한 방식으로 재현할 수 있다는 것이다. 이는 하나의 AI 모델이 다양한 형태의 로봇을 통합 운영할 수 있는, 획기적인 확장 가능성을 시사한다.

구글은 이번 모델 확장과 관련해, 제미니 로보틱스-ER 1.5는 누구나 이용 가능한 구글 AI 스튜디오(Google AI Studio)의 API 형태로 공개하며, 이를 통해 개발자들이 물리적 세계와 밀접한 AI 애플리케이션을 구축할 수 있도록 유도했다. 반면 제미니 로보틱스 1.5는 특정 전략적 파트너에게만 제공돼, 보다 제한적인 방식으로 운영될 계획이다.

AI 기술이 디지털 영역을 넘어 현실 세계로 확장되는 흐름 속에서, 딥마인드의 이번 발표는 로봇과 인간의 협업 패러다임을 다시 쓰는 분기점으로 평가받고 있다. 특히 이번 모델은 단순 반복이 아닌 사고 기반 행동(Embodied Reasoning)을 구현함으로써 진정한 ‘지능형 물리 에이전트’의 실현 가능성을 보여줬다는 점에서 AI 산업 전반에 적지 않은 파장을 일으킬 것으로 전망된다.

1

1

![[인터뷰]](https://f1.tokenpost.kr/2026/05/gdqgcidain_th_860x0.webp)

![[마켓분석] 美 국채 수익률의 경고…](https://f1.tokenpost.kr/2026/05/ebnlzq5nob_th_860x0.webp)

![[TOKEN WATCH] “DEX가 CEX처럼 체결될 수 있다면” — HumidiFi, 솔라나 현물 거래의 숨은 실행 엔진](https://f1.tokenpost.kr/2026/05/6q4kjvgtnr_th_860x0.webp)

![[경제분석] 호르무즈 봉쇄 장기화… 시장이 보내는 '인플레 재점화' 경고](https://f1.tokenpost.kr/2026/05/0qy2phqkps_th_860x0.jpg)

![[토큰분석] 미국 암호화폐 법안 분수령…은행권](https://f1.tokenpost.kr/2025/01/l1gfjhb2f1_th_860x0.jpg)

![[마켓분석] 트럼프 방중 기대감에 빅테크·비트코인·원유 동반 강세…금·보잉은 약세](https://f1.tokenpost.kr/2026/05/v6fwcsfqtx_th_860x0.jpg)

![[Episode 12] IXO™2024 참여하고, 2억원 상당 에어드랍 받자!](https://f1.tokenpost.kr/2024/03/bk2tc5rpf6_th_860x0.png)

![[Episode 11] 코인이지(CoinEasy) 에어드랍](https://f1.tokenpost.kr/2024/02/g0nu4cmps6_th_860x0.png)

![[Episode 8] Alaya 커뮤니티 입장하고, $AGT 받자!](https://f1.tokenpost.kr/2023/10/0evqvn0brd_th_860x0.png)

![[Episode 6] 아트테크 하고, 에어드랍 받자!](https://f1.tokenpost.kr/2023/08/3b7hm5n6wf_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 598회차](https://f1.tokenpost.kr/2026/05/wjbgns2ci2_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 597회차](https://f1.tokenpost.kr/2026/05/kszis73dwo_th_860x0.png)

![[토큰포스트] 기사 퀴즈 596회차](https://f1.tokenpost.kr/2026/05/luhnvcj6e4_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 596회차](https://f1.tokenpost.kr/2026/05/tjh3hukuaj_th_860x0.webp)