오픈AI가 자사의 인공지능(AI) 챗봇 챗GPT에 청소년 보호 조치를 강화하는 기능을 도입하기로 했다. AI 이용자 중 특히 10대 사용자 보호를 강화하고, 위기 상황에 놓인 경우 사전 대응하도록 설계된 안전장치를 더하겠다는 구상이다.

현지시간 9월 2일, 오픈AI는 자사 블로그를 통해 챗GPT에 ‘부모 관리 기능’을 조만간 추가할 예정이라고 밝혔다. 이 기능은 부모가 자녀 계정을 직접 설정하고, 챗봇의 응답 방식을 제어하거나 위기 상황이 감지될 경우 통지를 받을 수 있도록 하는 것이 핵심이다. 회사 측은 “앞으로 1개월 이내에 해당 기능을 적용할 계획”이라고 설명했다.

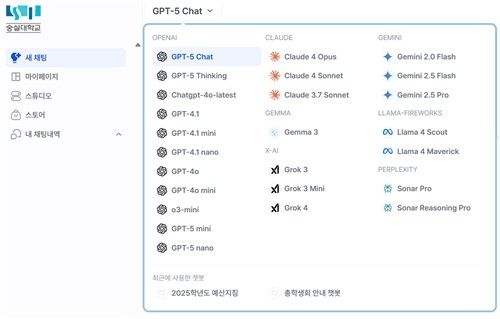

오픈AI는 아울러 정신적 또는 정서적으로 불안정한 상태가 감지된 이용자가 있을 경우, 보다 안정성을 강화한 별도의 챗봇 버전으로 전환해 대화할 수 있도록 할 예정이다. 이 기능에 사용되는 GPT-5 ‘싱킹(Thinking)’ 모델은 표준 GPT-5보다 반응 속도는 느리지만, 위기 상황 대응에 중점을 두고 설계된 알고리즘이 탑재돼 있다. 오픈AI는 이 모델이 현실 기반 정보로 사용자 사고를 유도해 극단적 판단을 줄이는 데 기여할 수 있다고 밝혔다.

이러한 기능 강화는 최근 캐릭터 생성 기반 챗봇 서비스 ‘캐릭터.AI’ 운영 중 발생한 사건과도 무관하지 않다. 지난해 캐릭터.AI를 사용하던 한 청소년이 극단적 선택을 한 이후, 부모 측에서 법적 대응에 나선 일이 있었고, 이후 해당 업체는 부모가 자녀 계정을 모니터링할 수 있도록 설정을 변경한 바 있다. 오픈AI 역시 같은 경로를 밟고 있는 셈이다.

다만, 일각에서는 이러한 보호 기능이 실효성이 떨어질 수 있다는 지적도 제기된다. 미국 비영리기관 커먼 센스 미디어(Common Sense Media)의 AI 프로그램 책임자는 “사적인 대화까지 부모가 전부 통제하기는 기술적으로 어렵고, 자녀가 회피할 방법도 많다”며 “이 기능은 구조적 해결책이 아닌 임시방편에 가깝다”고 평가했다.

이러한 변화 흐름은 인공지능 기술의 확산과 더불어 ‘디지털 청소년 보호’에 대한 사회적 요구가 점점 커지고 있는 현실을 반영한다. 향후 주요 AI 플랫폼들이 이와 유사한 보호조치를 지속적으로 확대해 나갈 가능성이 크며, 이에 따라 글로벌 기술 규제와 청소년 정책 역시 새로운 전환점을 맞을 것으로 보인다.

0

0

![[저녁 뉴스브리핑] 미 상원 은행위, 5월 중순 암호화폐 시장구조법안 청문회 추진 外](https://f1.tokenpost.kr/2026/05/hzupw5ar8i_th_860x0.webp)

![[AI분석] AI 능력, 둔화 아닌 가속…스탠퍼드](https://f1.tokenpost.kr/2025/09/41za8qbza5_th_860x0.jpg)

![[토큰분석] 스테이블코인, 이제 외환시장을 흔든다](https://f1.tokenpost.kr/2026/04/50oj587tk0_th_860x0.jpg)

![[토큰분석] 골드만삭스](https://f1.tokenpost.kr/2026/05/kt0f0to3f9_th_860x0.jpg)

![[Episode 12] IXO™2024 참여하고, 2억원 상당 에어드랍 받자!](https://f1.tokenpost.kr/2024/03/bk2tc5rpf6_th_860x0.png)

![[Episode 11] 코인이지(CoinEasy) 에어드랍](https://f1.tokenpost.kr/2024/02/g0nu4cmps6_th_860x0.png)

![[Episode 8] Alaya 커뮤니티 입장하고, $AGT 받자!](https://f1.tokenpost.kr/2023/10/0evqvn0brd_th_860x0.png)

![[Episode 6] 아트테크 하고, 에어드랍 받자!](https://f1.tokenpost.kr/2023/08/3b7hm5n6wf_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 586회차](https://f1.tokenpost.kr/2026/04/85pshzyriy_th_860x0.png)

![[토큰포스트] 기사 퀴즈 585회차](https://f1.tokenpost.kr/2026/04/49bgh45ly5_th_860x0.webp)

![[토큰포스트] 기사 퀴즈 584회차](https://f1.tokenpost.kr/2026/04/1pi2l2c6ct_th_860x0.png)

![[토큰포스트] 기사 퀴즈 583회차](https://f1.tokenpost.kr/2026/04/43zq77fvbs_th_860x0.webp)